- +90 216 455-1865

- info@compecta.com

KI-RECHENZENTRUM IN EINER BOX

Data-Science-Teams stehen an der Spitze der Innovation, müssen jedoch oft nach verfügbaren KI-Rechenzyklen suchen, um Projekte abzuschließen. Sie benötigen eine dedizierte Ressource, die überall angeschlossen werden kann und mehreren gleichzeitigen Benutzern überall auf der Welt maximale Leistung bietet. NVIDIA DGX Station™ A100 bringt KI-Supercomputing für Data-Science-Teams und bietet Rechenzentrumstechnologie ohne Rechenzentrum oder zusätzliche IT-Infrastruktur. Leistungsstarke Leistung, ein vollständig optimierter Software-Stack und direkter Zugriff auf NVIDIA DGXperts sorgen dafür, dass Sie schneller Erkenntnisse gewinnen.

Rechenzentrumsleistung überall

KI-Supercomputing für Data-Science-Teams

Mit der DGX Station A100 können Unternehmen mehreren Benutzern eine zentrale KI-Ressource für alle Arbeitslasten – Schulung, Inferenz, Datenanalyse – bereitstellen, die einen sofortigen Einstieg in die NVIDIA DGX™-basierte Infrastruktur ermöglicht und mit anderen NVIDIA-zertifizierten Systemen zusammenarbeitet. Und mit Multi-Instance GPU (MIG) ist es möglich, bis zu 28 separate GPU-Geräte einzelnen Benutzern und Jobs zuzuweisen.

Rechenzentrumsleistung ohne Rechenzentrum

Die DGX Station A100 ist ein KI-System der Serverklasse, das weder Strom noch Kühlung im Rechenzentrum benötigt. Es umfasst vier NVIDIA A100 Tensor Core GPUs, eine erstklassige CPU der Serverklasse, superschnellen NVMe-Speicher und hochmoderne PCIe Gen4-Busse sowie Fernverwaltung, sodass Sie es wie einen Server verwalten können.

Eine KI-Appliance, die Sie überall platzieren können

Die DGX Station A100 wurde für die agilen Data-Science-Teams von heute entwickelt, die in Unternehmensbüros, Laboren, Forschungseinrichtungen oder sogar von zu Hause aus arbeiten. Sie erfordert keine komplizierte Installation oder umfangreiche IT-Infrastruktur. Schließen Sie es einfach an eine Standardsteckdose an, um es in wenigen Minuten betriebsbereit zu machen und von überall aus zu arbeiten.

Größere Modelle, schnellere Antworten

NVIDIA DGX Station A100 ist das weltweit einzige bürofreundliche System mit vier vollständig miteinander verbundenen und MIG-fähigen NVIDIA A100-GPUs, die NVIDIA® NVLink® für die Ausführung paralleler und mehrerer Jobs nutzen Benutzer ohne Beeinträchtigung der Systemleistung. Trainieren Sie große Modelle mit einem vollständig GPU-optimierten Software-Stack und bis zu 320 Gigabyte (GB) GPU-Speicher.

Schnellere Iteration und Innovation

Hochleistungsschulungen steigern Ihre Produktivität, was zu einer schnelleren Gewinnung von Erkenntnissen und einer schnelleren Markteinführung führt.

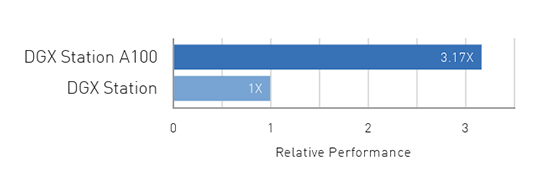

TRAINING

BERT Large Pre-Training Phase 1

Mehr als dreimal schneller

DGX Station A100 320GB; Batch Size=64; Mixed Precision; With AMP; Real Data; Sequence Length=128

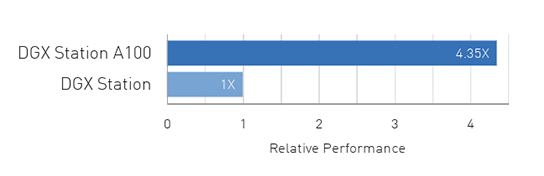

INFERENZ

BERT Large Inference

Mehr als viermal schneller

DGX Station A100 320 GB; Chargengröße=256; INT8 Präzision; Synthetische Daten; Sequenzlänge=128, cuDNN 8.0.4

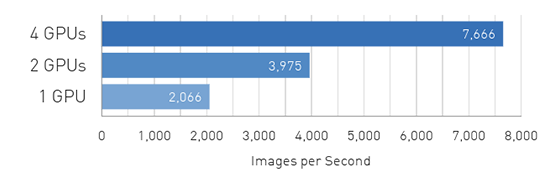

MULTI-GPU-SKALIERBARKEIT

ResNet-50 V1.5-Schulung

Lineare Skalierbarkeit

DGX Station A100 320 GB; Stapelgröße=192; Gemischte Präzision; Echte Daten; cuDNN-Version=8.0.4; NCCL-Version=2.7.8; NGC MXNet 20.10 Container

KI-Training

Deep-Learning-Datensätze werden immer größer und komplexer, wobei Arbeitslasten wie Konversations-KI, Empfehlungssysteme und Computer Vision branchenübergreifend immer häufiger eingesetzt werden. Die NVIDIA DGX Station A100, die über einen integrierten Software-Stack verfügt, ist im Vergleich zu PCIe-basierten Workstations darauf ausgelegt, bei komplexen KI-Modellen die schnellste Zeit bis zur Lösung zu liefern.

KI-Inferenz

Typischerweise werden Inferenz-Workloads im Rechenzentrum bereitgestellt, da sie alle verfügbaren Rechenressourcen nutzen und eine agile, elastische Infrastruktur erfordern, die skaliert werden kann. Die NVIDIA DGX Station A100 eignet sich perfekt zum lokalen Testen der Inferenzleistung und -ergebnisse vor dem Einsatz im Rechenzentrum, dank integrierter Technologien wie MIG, die Inferenz-Workloads beschleunigen und den höchsten Durchsatz und die höchste Echtzeit-Reaktionsfähigkeit bieten, die für die Umsetzung von KI-Anwendungen erforderlich sind.

Datenanalyse

Tag für Tag generieren und sammeln Unternehmen beispiellose Datenmengen. Diese enorme Menge an Informationen stellt eine verpasste Chance für diejenigen dar, die keine GPU-beschleunigte Analyse nutzen. Je mehr Daten Sie haben, desto mehr können Sie lernen. Mit der NVIDIA DGX Station A100 können Data-Science-Teams schneller als je zuvor umsetzbare Erkenntnisse aus ihren Daten ableiten.

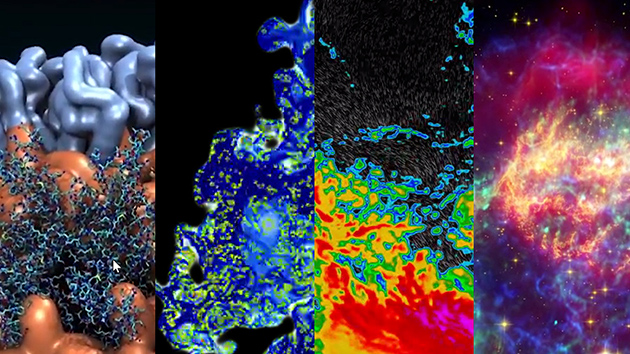

High-Performance Computing

Hochleistungsrechnen (HPC) ist eines der wichtigsten Instrumente für den Fortschritt der Wissenschaft. NVIDIA-GPUs optimieren über 700 Anwendungen in einem breiten Spektrum von Bereichen und sind der Motor des modernen HPC-Rechenzentrums. Ausgestattet mit vier NVIDIA A100 Tensor Core GPUs ist die DGX Station A100 das perfekte System für Entwickler, um wissenschaftliche Workloads vor der Bereitstellung auf ihren HPC-Clustern zu testen und so im Büro oder sogar von zu Hause aus bahnbrechende Leistung zu liefern.

Bestellen Sie noch heute Ihre NVIDIA DGX A100

Erstellen Sie Ihre private Cloud der Enterprise-Klasse für KI. Kaufen Sie NVIDIA DGX-Systeme von zertifizierten Partnern, die Full-Stack-Accelerated-Computing-Lösungen von NVIDIA anbieten.

NVIDIA Academic-Rabatte verfügbar. Bitte wenden Sie sich an uns, um Informationen zu den Teilnahmevoraussetzungen und den rechtlichen Bedingungen zu erhalten.

Mehr Informationen erhalten!

Unsere Experten können all Ihre Fragen beantworten. Bitte erreichen Sie uns per Mail oder Telefon.

TÜRKÇE

TÜRKÇE ENGLISH

ENGLISH DEUTSCH

DEUTSCH